Сотрудники Apple выражают озабоченность по поводу новых функций безопасности детей, которые дебютируют в iOS 15 этой осенью, при этом некоторые говорят, что решение о развертывании таких инструментов может запятнать репутацию Apple как оплота конфиденциальности пользователей.

Противодействие недавно объявленным мерам Apple по обеспечению безопасности детей теперь включает критиков из ее собственных рядов, которые высказываются по этому поводу во внутренних каналах Slack, сообщает Reuters.

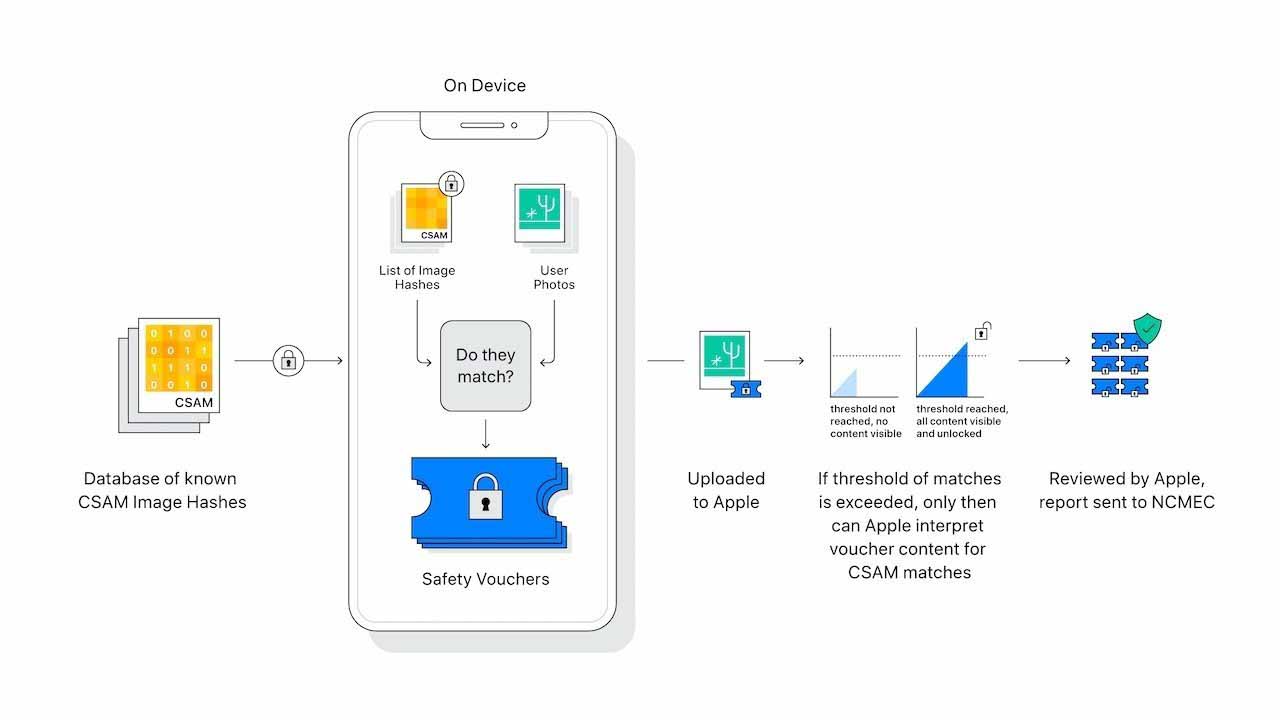

Анонсированный на прошлой неделе набор инструментов Apple для защиты детей включает в себя процессы на устройстве, предназначенные для обнаружения и сообщения о материалах сексуального насилия над детьми, загруженных в iCloud Photos. Другой инструмент защищает детей от конфиденциальных изображений, отправляемых через Сообщения, в то время как Siri и Поиск будут обновлены ресурсами для решения потенциально небезопасных ситуаций.

С момента обнародования мер Apple CSAM сотрудники отправили более 800 сообщений на канал Slack по теме, которая оставалась активной в течение нескольких дней, говорится в отчете. Те, кто обеспокоен предстоящим развертыванием, ссылаются на общие опасения по поводу потенциальной эксплуатации со стороны правительства — теоретическую возможность, которую Apple сочла крайне маловероятной в новом документе поддержки и заявлениях для СМИ на этой неделе.

В отчете говорится, что сопротивление внутри Apple, по крайней мере в том, что касается потоков Slack, похоже, исходит от сотрудников, которые не являются частью ведущих групп компании по безопасности и конфиденциальности. Согласно источникам Reuters, те, кто работает в сфере безопасности, не выглядели «основными истцами» в сообщениях, а некоторые защищали позицию Apple, говоря, что новые системы являются разумным ответом на CSAM.

В теме, посвященной предстоящей функции «сканирования» фотографий (инструмент сопоставляет хэши изображений с хэшированной базой данных известного CSAM), некоторые работники возражают против критики, в то время как другие говорят, что Slack не является форумом для таких обсуждений, говорится в отчете. . Некоторые сотрудники выразили надежду, что инструменты на устройстве обеспечат полное сквозное шифрование iCloud.

Apple сталкивается с какофонией осуждения со стороны критиков и защитников конфиденциальности, которые говорят, что протоколы безопасности детей поднимают ряд красных флажков. В то время как некоторые из возражений можно списать на дезинформацию, возникшую из-за базового непонимания технологии Apple CSAM, другие вызывают обоснованные опасения по поводу замедления миссии и нарушений конфиденциальности пользователей, которые изначально не рассматривались компанией.

Технический гигант из Купертино попытался потушить пожар, отреагировав на часто упоминаемые проблемы в FAQ, опубликованном на этой неделе. Руководители компании также ходят в средствах массовой информации, чтобы объяснить, что Apple рассматривает как решение особо одиозной проблемы, ориентированное на конфиденциальность. Однако, несмотря на все усилия, разногласия по-прежнему остаются.

Инструмент обнаружения CSAM от Apple запускается с iOS 15 этой осенью.