Пара исследователей из Принстона заявляет, что система обнаружения CSAM от Apple опасна, потому что они исследовали и предостерегли от подобных технологий, но эти две системы далеко не идентичны.

Джонатан Майер и Анунай Кулшреста недавно написали статью для Washington Post, в которой подробно описали некоторые из своих опасений по поводу системы обнаружения Apple CSAM. Исследователи безопасности написали, что они построили аналогичную систему двумя годами ранее, но только для того, чтобы предостеречь от этой технологии после того, как осознали подводные камни ее безопасности и конфиденциальности.

Например, Майер и Кульшреста утверждают, что эту службу можно легко перепрофилировать для слежки со стороны авторитарных правительств. Они также предполагают, что система может страдать от ложных срабатываний и может быть уязвима для злоумышленников, подвергающих невиновных пользователей ложным флагам.

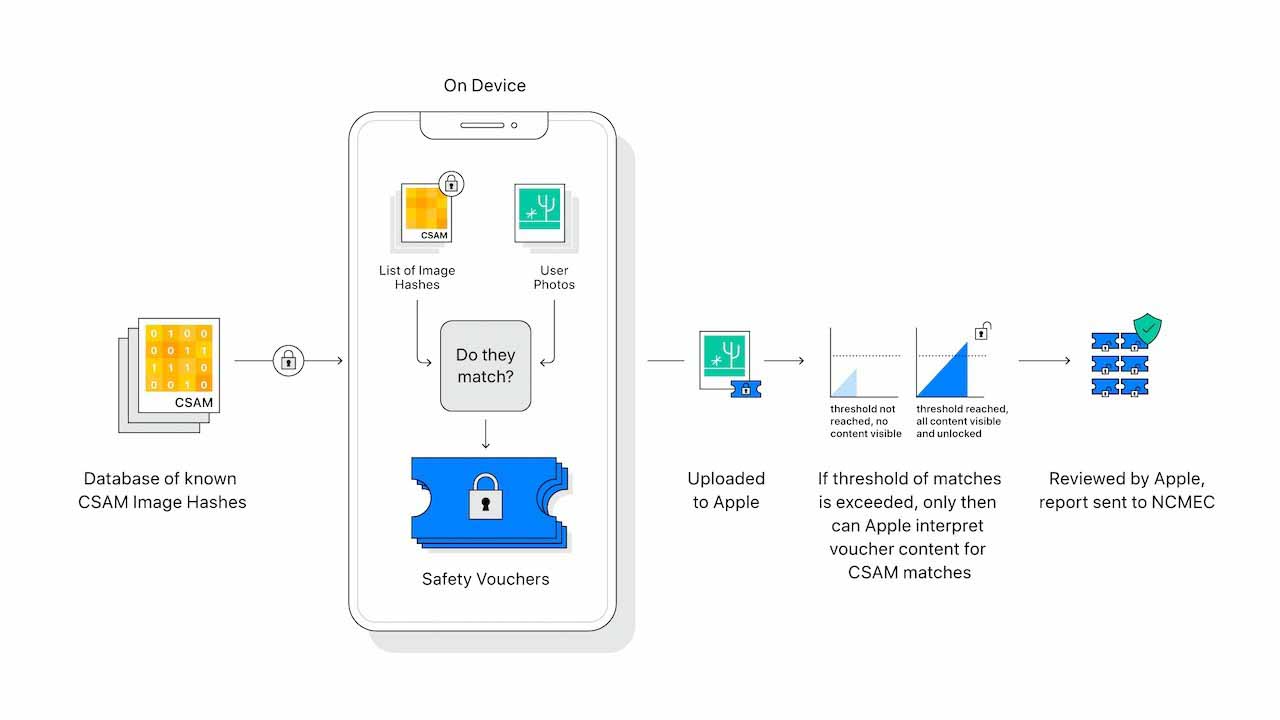

Кроме того, опасения, что правительство может легко заменить базу данных, полную диссидентских высказываний, не оправдываются. База данных Apple содержит хэши, полученные как минимум от двух организаций по безопасности детей из совершенно разных юрисдикций. Это обеспечивает защиту от единственного правительства, которое коррумпирует организацию, занимающуюся безопасностью детей.

Кроме того, такая схема должна будет полагаться на аудиторов Apple, которые также будут сотрудничать. Apple заявляет, что помеченные аккаунты проверяются аудиторами на предмет ложных срабатываний. Если команда Apple обнаружит учетные записи, помеченные как материалы, не относящиеся к CSAM, Apple заявляет, что они заподозрят что-то неладное и перестанут получать базу данных из этих организаций.

Ложные срабатывания также невероятно редки в системах Apple. Компания заявляет, что вероятность ложно помеченной учетной записи составляет один из триллионов. Опять же, даже если учетная запись ошибочно помечена, наличие CSAM должно быть подтверждено до создания любого отчета для организаций по безопасности детей.

Есть также защита от злоумышленника, отправляющего CSAM невиновному человеку. Система Apple обнаруживает только коллекции CSAM в iCloud. Если пользователь сам не сохранит CSAM в iCloud или его учетная запись Apple не будет взломана изощренным злоумышленником, шансов на успех такого мошенничества мало.

Кроме того, пользователи смогут убедиться, что база данных известных хэшей CSAM, хранящаяся локально на их устройствах, соответствует базе данных, поддерживаемой Apple. База данных также не может быть таргетированной — она применяется ко всем пользователям в определенной стране.

Система Apple также полагается на сканирование на стороне клиента и локальный интеллект на устройстве. Также существует порог для CSAM — пользователь должен преодолеть этот порог, чтобы даже быть помеченным.

Другими словами, два исследователя безопасности построили систему, лишь отдаленно напоминающую систему Apple. Несмотря на то, что могут быть веские аргументы в пользу «ползучести миссии» и конфиденциальности, система Apple была построена с нуля для решения хотя бы некоторых из этих проблем.