Apple опубликовала ответ на критику конфиденциальности своей новой функции iCloud Photos для сканирования изображений насилия над детьми, заявив, что она «откажется» от давления со стороны правительства с целью нарушения конфиденциальности.

Набор инструментов Apple, предназначенных для защиты детей, вызвал неоднозначную реакцию со стороны экспертов по безопасности и конфиденциальности, при этом некоторые ошибочно заявили, что Apple отказывается от своей политики конфиденциальности. Теперь Apple опубликовала опровержение в виде документа с часто задаваемыми вопросами.

«В Apple наша цель — создать технологию, которая расширяет возможности людей и обогащает их жизнь, помогая им оставаться в безопасности», — говорится в полной версии документа. «Мы хотим защитить детей от хищников, которые используют средства коммуникации для вербовки и эксплуатации, а также ограничить распространение материалов о сексуальном насилии над детьми (CSAM)».

«С тех пор, как мы объявили об этих функциях, многие заинтересованные стороны, включая организации, занимающиеся вопросами конфиденциальности и безопасности детей, выразили свою поддержку этому новому решению, — продолжает он, — а некоторые задали вопросы».

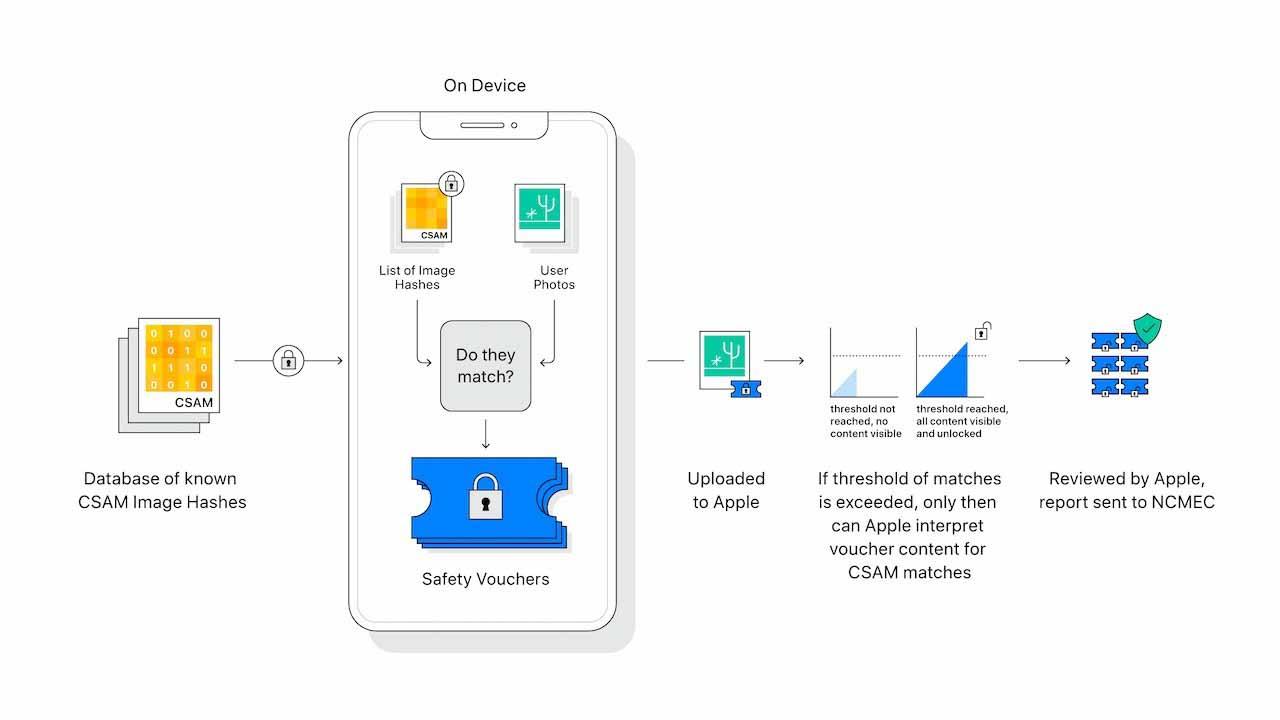

«В чем разница между безопасностью связи в сообщениях и обнаружением CSAM в iCloud Photos?» он спрашивает. «Эти две функции не совпадают и используют разные технологии».

Apple подчеркивает, что новые функции в Сообщениях «предназначены для того, чтобы дать родителям … дополнительные инструменты для защиты своих детей». Изображения, отправленные или полученные с помощью Сообщений, анализируются на устройстве «, и поэтому [the feature] не изменяет гарантии конфиденциальности Сообщений «.

Обнаружение CSAM в iCloud Photos не отправляет в Apple информацию о «каких-либо фотографиях, кроме тех, которые соответствуют известным изображениям CSAM».

Большая часть документа подробно описывает то, что AppleInsider разразила в пятницу. Тем не менее, есть несколько пунктов, которых не было раньше.

Во-первых, эксперты по конфиденциальности и безопасности обеспокоены тем, что сканирование изображений на устройстве может быть легко расширено в пользу авторитарных правительств, требующих от Apple расширения того, что она ищет.

«Apple откажется от любых таких требований», — говорится в документе с часто задаваемыми вопросами. «Мы и раньше сталкивались с требованиями создать и внедрить санкционированные правительством изменения, которые ухудшают конфиденциальность пользователей, и упорно отказывались от этих требований. Мы продолжим отказывать им в будущем».

«Давайте проясним, — продолжает он, — эта технология ограничена обнаружением CSAM, хранящегося в iCloud, и мы не будем выполнять запросы правительства о ее расширении».

Новая публикация Apple по этой теме появилась после того, как было отправлено открытое письмо с просьбой пересмотреть свои новые функции.

Во-вторых, хотя AppleInsider уже заявлял об этом ранее, основываясь на комментариях Apple, компания недвусмысленно пояснила, что эта функция не работает, когда iCloud Photos выключен.

![«Это способ… найти друзей», — гласит умная реклама нового iPhone 15. [Video]](https://applepro.news/wp-content/uploads/2024/05/1714781228_eto-sposob…-najti-druzej-—-glasit-umnaya-reklama-novogo-iphone-100x100.jpg)